Lo que necesitas saber:

La policía de Las Vegas mostró varias de las consultas que el responsable hizo a ChatGPT... OpenAI explicó que la IA sólo respondió con información ya conocida y advirtiendo que era ilegal y riesgoso.

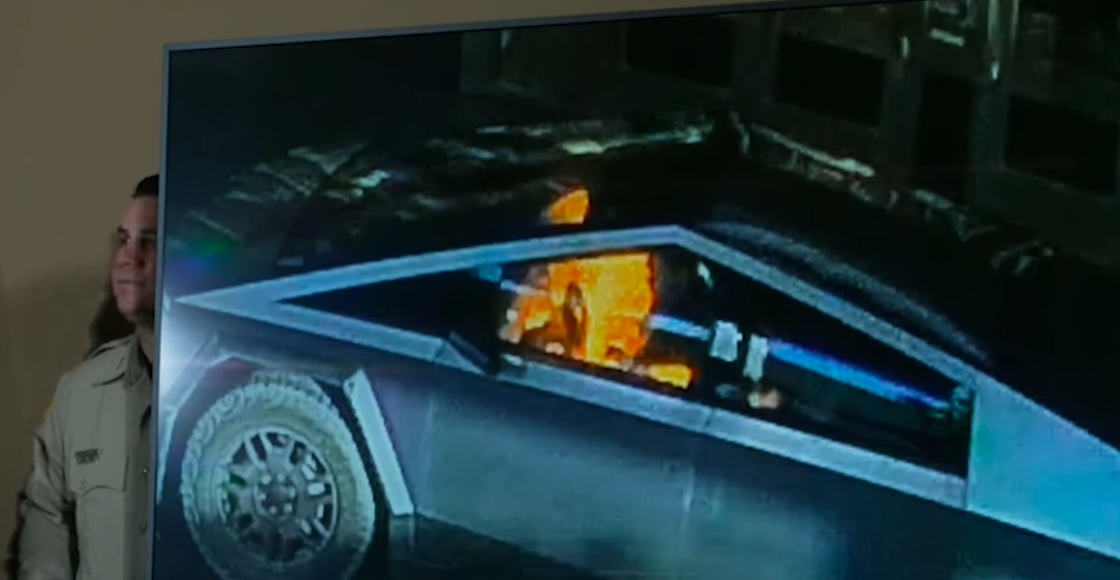

Aunque luego la Inteligencia Artificial generativa se hace de la boca chiquita cuando uno le pregunta cosas polémicas, resulta que pudo haber ayudado al soldado que hizo explotar una Cybertruck a las afueras de un hotel de Donald Trump, en Las Vegas.

La elaboración del explosivo fue consultada a ChatGPT

¿Cómo? Eso pregúntenselo a su IA de confianza. La policía de Estados Unidos sólo ha soltado que, según las investigaciones, Mathew Livelsberger (el responsable de la explosión de la Cybertruck) se apoyó en ChatGPT para buscar información sobre explosivos.

Según las autoridades, Livelsberger investigó a qué velocidad volarían ciertas municiones. También le consultó a la Inteligencia Artificial si algunos explosivos y viejos artificiales eran legales en el estado de Nevada.

OpenAI dice que la IA sólo uso información de internet… pero bajo advertencia que era malo

“Este es el primer incidente del que tengo conocimiento en suelo estadounidense en el que se utiliza ChatGPT para ayudar a una persona a construir un dispositivo en particular”, señaló Kevin McMahill, sheriff del Departamento de Policía Metropolitana de Las Vegas.

“Es preocupante”, aceptó el funcionario de Las Vegas, luego de mostrar los pantallazos de las consultas que se le hizo a la Inteligencia Artificial para elaborar el explosivo que detonó a la Cybertruck.

De acuerdo con AP, OpenAI (empresa responsable de ChatGPT) envió un correo en el que dice estar comprometido con garantizar que sus herramientas se utilicen responsablemente…así que están diseñadas para rechazar instrucciones que sean perjudiciales.

En este caso, explicó OpenAI, ChatGPT respondió con la información ya disponible en internet y advirtiendo que la elaboración de explosivos es una actividad perjudicial o ilegal. “Estamos trabajando con las autoridades para apoyar su investigación”, aseguró OpenAI.