China se fue contra los deepfakes para regularlosen un mundo cada vez más marcado por la inteligencia artificial generativa.

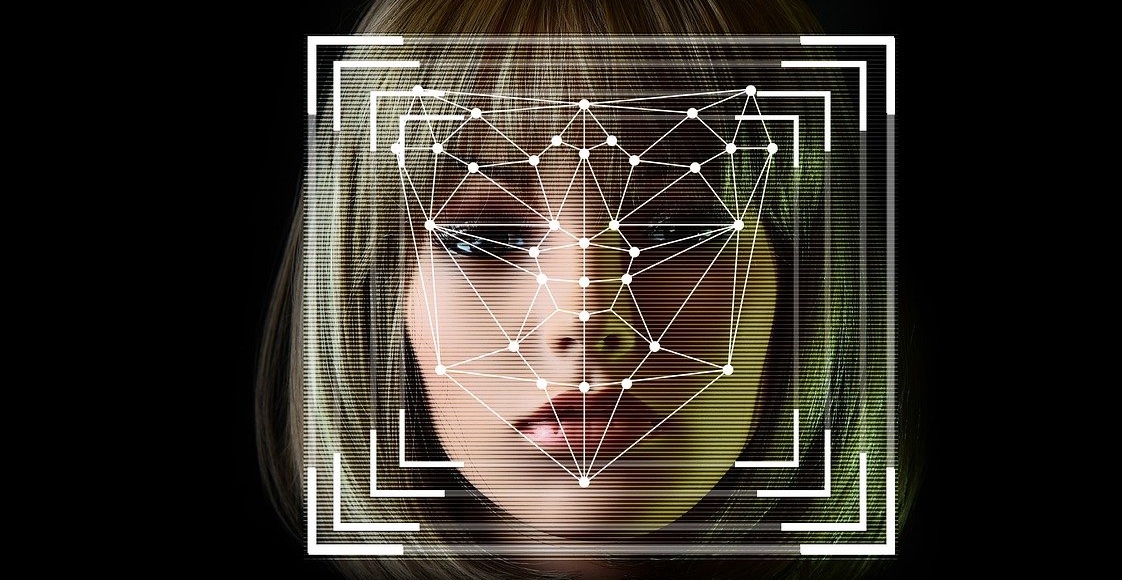

A lo largo del siglo XX y lo que va del XXI, China ha buscado mantener controles fuertes sobre el contenido que se disemina y consume por la población del país. Pero en últimos tiempos ha arreciado en la materia, en la medida que la inteligencia artificial (IA) modifica por completo las formas en que se generan y distribuyen esos productos textuales o audiovisuales; por ejemplo, recientemente estableció que cualquier app o plataforma que emplee algoritmos de reconocimiento de patrones o recopilación de datos debe hacer explícito qué información recopila.

Y en ese mismo camino que ha seguido, a partir de enero de este 2023, China se fue contra los deepfakes para regularlos en la medida de lo posible, en un mundo cada vez más marcado por la inteligencia artificial generativa.Se trata de un esfuerzo enorme—y que quizá terminará por ser imposible—, pero que busca al menos tres puntos centrales con esta tecnología que combina video, audio y, por supuesto, inteligencia artificial.

En primer lugar, pone sobre la mesa que cualquier deepfake que se realice sin consentimiento explícito tendrá consecuencias legales (incluso penales). Asimismo, que cualquier tipo de noticia falsa que se disemine con esa tecnología lleve algún tipo de castigo. Por último, que todo contenido sintético (como se le conoce también a los deepfakes) informe a las personas que es “falso”.

Las regulaciones de los contenidos en China son fuertes. Al grado de que establecen candados al uso de videojuegos y a las formas en que se deben comportar públicamente las estrellas pop. Pero esta nueva guerra contra los deepfakes quizá puede enseñarle algo al resto del mundo.

El poder de los deepfakes

Lo interesante de este nuevo marco regulatorio para los deepfakes en China es que muestra que tienen mucho más importancia de la que se suele darles. Por lo general, no pasan de ser memes curiosos del internet o para neurotizar colectivamente a fandoms que esperan películas con seis mil spidermans en ellas.

Pero la realidad es que con ese tipo de inteligencia artificial se pueden llevar a cabo acciones terribles. Desde fraudes y robos de identidad hasta la creación de noticias falsas con personajes públicos diciendo cualquier tipo de tontería, hay un peligro detrás de los deepfakes que con frecuencia se soslaya.

Basta con ver lo que puede hacer una inteligencia artificial para imitar voces en cuestión de segundos para imaginar los alcances de tecnologías de este tipo. Y que quizá estamos todavía a tiempo para regularlas, de tal modo que sean útiles y benéficas… en vez de peligrosas.

La inteligencia artificial y la producción de contenido

Desde el año pasado se han avivado discusiones sobre los alcances y posibilidades de la inteligencia artificial. Esto se da particularmente en un contexto en el que la IA generativa ofrece posibilidades de crear textos, vídeos e imágenes sin la necesidad de una mediación humana y con características que cada vez se acercan más a parecer “reales”. No es de a gratis que Microsoft recién anunció una inversión milmillonaria a la empresa detrás de ChatGPT.

Cuando se juntan distintas herramientas de inteligencia artificial generativa—incluidos chatbots, moduladores de voz y deepfakes—no es difícil empezar a imaginar distopías muy concretas e inmediatas: medios de comunicación con la posibilidad de crear contenido infinito sin la necesidad de revisarlo; sobre todo, combinando elementos “reales” con “falsos” en modelos sintéticos.

La regulación de China quizá suena agresiva; sin duda, también tiene tintes autoritarios. Pero se trata de marcos que quizá serán básicos para el futuro. Porque, si no, se tendrá que generar una IA que pueda identificar si algo fue producido por una IA; obviamente, para que después otra IA aprenda a crear contenido que no pueda ser identificado… por IAs hechas para identificar contenidos producidos por una IA… y así, ad nauseam.